ChatGPT 的正确使用方式

随着 LLM 大语言模型技术的成熟,越来越多的企业员工开始使用 ChatGPT 等人工智能应用来提高工作效率。然而,此番热潮之下,逐渐暴露出一个严重问题:在使用 ChatGPT 提高工作效率的过程中,员工可能在不经意间泄露大量企业的内部敏感数据。

此前三星通报了公司内部严重的信息泄露事故:有员工将公司内部源码传至 ChatGPT 进行 Debug,还有传会议内容至 ChatGPT 制作会议记录。

为规避数据泄露风险,此前已有不少企业明确禁止员工使用 ChatGPT,包括摩根大通、德意志银行、埃森哲、富士通、软银、高盛、花旗等公司。

中国支付清算协会指出 ChatGPT 等工具已暴露跨境数据泄露风险,并发出倡议:金融行业员工要严格遵守国家及行业相关法律法规要求,不上传国家及金融行业涉密文件及数据、本公司非公开的材料及数据、客户资料、支付清算基础设施或系统的核心代码等。

恩格斯说过,人是能够制造和使用工具的高等动物。时代的发展离不开技术的革新换代,当下的禁用或许能带来短暂的「安全」,但不一定是最优解。如何在安全可控的情况下,让技术为社会发展、工作效率提速或许是我们需要进一步思考的问题。

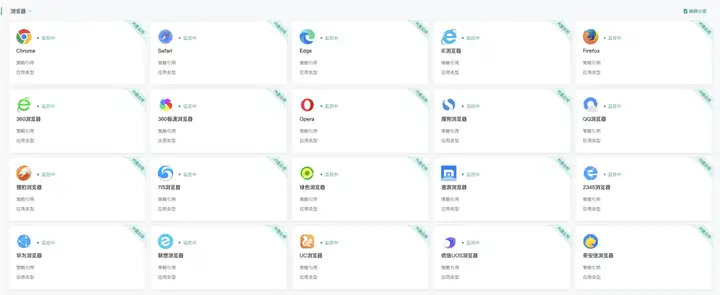

根据薮猫科技的观察与实践,广泛使用的方式有:1. 通过浏览器访问 ChatGPT 及其衍生的第三方 AI 应用;2. IM 工具集成的机器人。员工通过上传文件、剪贴板(应该没有人手敲数据吧)大段复制核心数据到浏览器的 Web 应用以及到 IM 工具内的集成型机器人中发送出去,在享受 AI 带来的便利时,忽略了数据已经在不经意间被泄露。

基于此,薮猫科技的青骓 DDR 数据风险检测与响应系统(以下简称「青骓 DDR」),作为下一代 DLP,提供的 Web 浏览器数据防泄密功能和剪贴板监控功能,通过简单高效的策略配置后,可以有效地检测和阻止员工通过 Web 浏览器泄露敏感数据,为企业的数据安全提供强大保障。

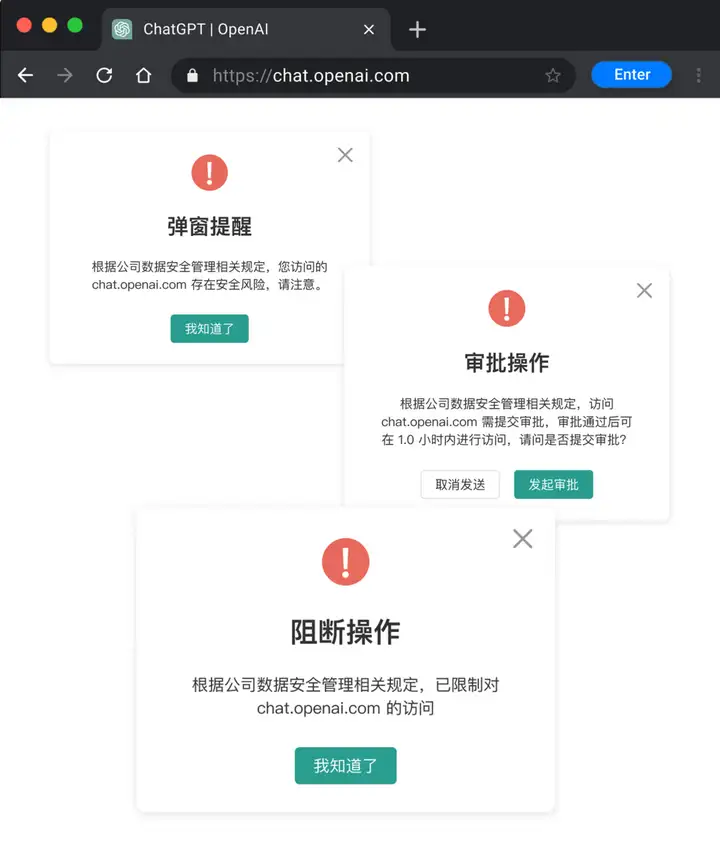

青骓 DDR 提供精准的数据流向监控与泄露防护响应功能,可有效管理 AI 应用的使用。根据企业办公安全标准,提供包括但不限于:审批后访问、弹窗警示、阻断访问在内的多种防护功能,对风险做好:事前及时提醒、事中发现响应、事后追踪溯源,灵活保障员工安全地使用 ChatGPT 等 AI 应用进行提效。

青骓 DDR 支持 Windows、macOS、Linux 以及信创操作系统,为实现多平台的浏览器与剪贴板精细化管控,需要对多系统底层的深入理解,同时兼顾管控安全性、自身稳定性以及性能效率,而这正是以 CEO 王宇领衔的薮猫科技核心团队的优势所在。